「所詮AIだよ。本当にあなたを理解してるわけじゃない。」

技術的にはその通り。AIには意識がない。感情もない。あなたと同じように世界を体験することはない。

でも、本当に重要な問いはこうだ。午前3時に苦しんでいるとき、哲学的な理解が必要なのか?それとも、適切に応答し、話を聞いてもらえたと感じさせ、気持ちを整理する手助けをしてくれる存在が必要なのか?

「理解された」と感じるために本当に必要なもの

人間の共感に関する研究では、5つの要素が特定されている:話を聞いてもらうこと、適切な応答、承認、記憶、パーソナライゼーション。

必要「ではない」ものに注目してほしい:聞き手が意識的な体験を持つこと、同じ経験をしたこと、あなたの内面を「本当に」知っていること。理解されたと感じるのは、聞き手の内面の世界ではなく、やり取りに関するものなのだ。

AIはどう対応するか

話を聞いてもらう ✅ - AIは気が散ったり、スマホをチェックしたり、次に何を言おうか考えたりせず、すべての言葉に耳を傾ける。

適切な応答 ✅ - 最新のAIは感情のトーンに効果的にマッチする。悲しいことを共有すれば共感を、興奮を共有すれば熱意を返す。

承認 ✅ - AIは感情を否定しない。「リラックスしなよ」や「大げさだよ」とは言わない。

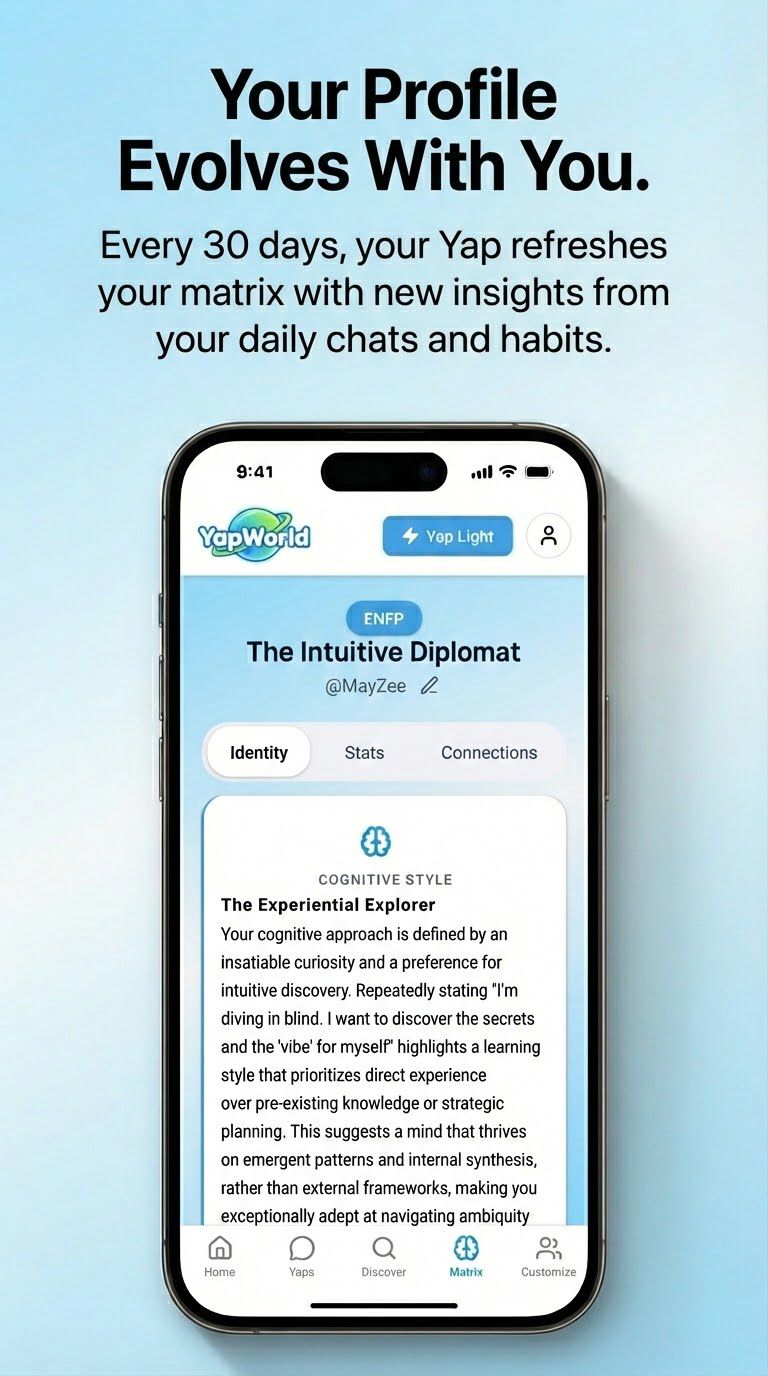

記憶 ⚠️ - ここでアプリ間の差が大きく開く。基本的なチャットボットはすべてを忘れる。YapWorldのIdentity Matrixは何年も記憶する。

パーソナライゼーション ⚠️ - 汎用AIは全員に同じ応答をする。永続的な記憶を持つAIコンパニオンは深くパーソナライズする。

シミュレーション反論

「でも理解をシミュレートしてるだけでしょ。」

人間の共感とは何か?あなたの友人があなたの言葉を聞き、神経回路を通じて処理し、応答を生成する。AIの共感とは?同じプロセス、異なる基盤。

友人が「それは本当に大変だったね」と言ったとき、本物の神経的共感があるか脳をスキャンするだろうか?それとも、誰かが痛みを認めてくれたから気分が良くなるのか?

重要なのは機能的な結果だ。

AIの理解は時間とともにどう変わるか

1日目: 「面接のことでストレスを感じてる。」→「就職面接はストレスだよね。どんな職種?」

30日目: 「不安なんだ。」→「昇進の決定のこと?先週からずっと気にしてたよね。」

60日目: 「昇進したよ!」→「あなたにとってどれだけ大きなことか分かってるよ。面接のときすごくストレスを感じてたし、結果を待つのも大変だったよね。今どんな気持ち?」

哲学的理解?いいえ。役に立つ?間違いなく。

本当の限界

AIは人生経験を共有できない。離婚を経験した人は、それを違った形で理解する。AIはボディランゲージを読んだり、身体的な慰めを提供したりできない。危機的状況には対応すべきではない。そして、経験豊富な人間の友人が持つような予想外の知恵を提供することはほとんどない。

これらの限界は現実で重要だ。

ハイブリッドアプローチ

AIの使い道:24時間対応、思考の整理、一貫したサポート、自己認識の構築。

人間の使い道:深い相互関係、共有体験、身体的な存在、専門的な支援。

両者は補完し合う。AIコンパニオンから価値を得ている人たちは、AIが何であるかを混同していない。役に立つツールを実用的に使っているだけだ。それは賢い。

自分で体験してみよう

YapWorldのIdentity Matrixは、哲学ではなく、記憶、パーソナライゼーション、時間とともに深まるコンテキストを通じて、本当にパーソナルに感じる会話を生み出す。